- Apple gaat actief speuren naar kindermisbruik door foto’s van gebruikers te scannen.

- De software die hiervoor wordt ingezet respecteert de privacy en heeft een foutmarge van 1 op 1 biljoen.

- Critici denken dat deze stap de deur opent naar vergelijkbare, maar gevaarlijkere initiatieven.

Apple is van plan om vanaf dit jaar foto’s te scannen van Amerikaanse gebruikers. Dit gebeurt met nieuwe software die specifiek kijkt naar sporen van kindermisbruik op foto’s.

Het bedrijf kan, na menselijke controle, de foto’s naar de autoriteiten sturen zodat die mogelijk stappen kunnen ondernemen tegen de specifieke gebruiker. Dit laat het bedrijf weten via een speciale pagina op de website.

Meerdere techgiganten scannen al langer de foto’s van gebruikers, maar ze doen dit pas als de beelden zijn geüpload naar hun servers. Apple gaat een stap verder. Het bedrijf uit Cupertino gaat foto’s scannen terwijl ze nog op de iPhone of iPad staan.

Ze hoeven hiervoor dus niet naar iCloud (Apple’s cloudopslag) geüpload te worden. De foto’s op de telefoon of tablet worden machinaal vergeleken met foto’s die door het Amerikaanse National Center for Missing and Exploited Children (Nationaal Centrum voor Vermiste en Misbruikte Kinderen – NCMEC) zijn gelabeld als foto’s met daarop overduidelijk kindermisbruik.

Mocht Apple’s software een foto genoeg vinden lijken op één van de beelden uit de database van NCMEC, dan gaan nog niet gelijk alle alarmbellen af. De techgigant zegt te werken met een bepaalde hoeveelheid gelabelde foto’s voordat het systeem een melding geeft.

Tot die tijd kan niemand de foto's zien en bekijken door welke gebruiker ze gemaakt zijn. Pas als het systeem een melding geeft, kan Apple ervoor kiezen om een medewerker toegang te geven tot de foto's om daadwerkelijk te checken of het om kindermisbruik gaat.

Als dat het geval is, dan stuurt het bedrijf uit Cupertino de ingewonnen informatie door naar betreffende instanties zodat deze nogmaals alles kunnen controleren, en waar nodig kunnen ingrijpen.

Volgens Apple is de software extreem accuraat en geeft het niet zomaar een melding van kindermisbruik. De makers beweren dat er wordt gewerkt met een foutmarge van 1 op 1 biljoen.

Apple geeft zelf al aan dat het met meer instanties wil samenwerken die zich actief inzetten tegen kindermisbruik om het initiatief internationaal uit te rollen. Welke instanties dat zijn laat het bedrijf in het midden.

Critici zien potentiële gevaren in de stap van Apple

Toch zijn critici niet gerust op het speursysteem van Apple. Hoewel het in eerste instantie alleen maar goed lijkt, zien zij er gevaar in. Zo zou de stap ervoor kunnen zorgen dat regeringen softwaremakers onder druk gaan zetten om een vergelijkbaar systeem te bouwen, maar dan voor eigen gewin.

Edward Snowden deelde zijn zorg over het "doorlopend scannen" van iPhones op iPads door een quote van Ross Anderson, hoogleraar beveiligingstechniek van Universiteit van Cambridge, op Twitter te delen.

Anderson noemt Apple's idee in een artikel in de Financial Times "afschuwelijk". Volgens hem leidt het naar grootschalige surveillance van onze telefoons en laptops.

Kinderen worden extra beschermd

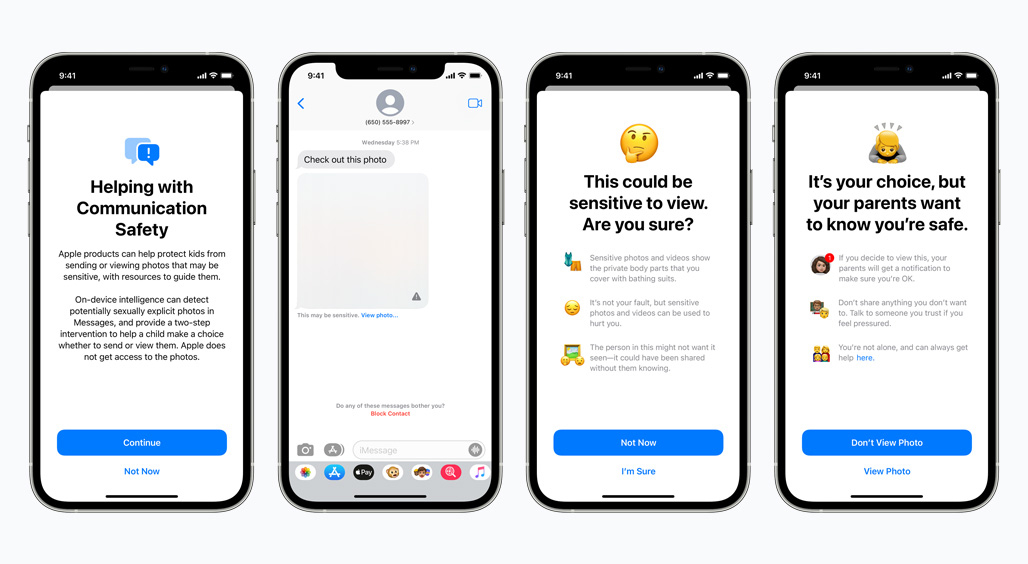

Naast het scannen van de fotobibliotheek van gebruikers, gaat Apple accounts van kinderen beschermen voor mogelijk seksueel getinte of gevaarlijke beelden. Als een kind in de Messages-app een potentieel offensieve foto ontvangt of probeert te versturen, zal Apple het beeld blurren.

Ook komt er een melding in beeld waarin het kind gewaarschuwd wordt dat als hij of zij de foto toch verstuurt of opent, zijn of haar ouders hiervan een melding krijgen. Dit systeem maakt gebruik van kunstmatige intelligentie op de telefoon. Apple krijgt nooit toegang tot wat er gebeurt in de Messages-app.

Lees meer over Apple:

- Apple verlaagt de prijzen in de App Store – voor het eerst sinds 2017 worden apps goedkoper

- Samsung is niet langer marktleider op de smartphonemarkt in Europa, Xiaomi neemt de troon over

- Wat is Mini-LED en waarom is het misschien wel beter dan OLED?

- Elon Musk haalt uit naar Apple en zegt dat Tesla nooit een ‘walled garden’ zal creëren om concurrenten te benadelen